❘ منتشر شده: 2023-05-26T10:41:54

❘ به روز شد: 2023-05-26T10:42:01

یک مطالعه جدید دقیقاً نشان داده است که چگونه می توان چت ربات های هوش مصنوعی مانند ChatGPT را در صورت کلاهبرداری یا حمله DDOS فریب داد و شناسایی کرد.

همانطور که ChatGPT، Google Bard و دیگر چت ربات های هوش مصنوعی شروع به هوشمندتر شدن می کنند، نگرانی های زیادی در مورد استفاده از آنها برای کلاهبرداری وجود دارد.

با توجه به توانایی مدلهای زبانی در ارائه پاسخهای نیمه واقعی، میتوان از این پاسخها برای فریب افرادی که ممکن است آنقدرها از فناوری آگاه نیستند استفاده کرد.

یک مطالعه جدید نشان داده است که اشتباه گرفتن هوش مصنوعی با معماهای مبتنی بر زبان یک راه مطمئن برای از بین بردن هوش مصنوعی از انسان است. این مقاله پیشنهاد میکند که میتوان از این روشها در آینده برای شناسایی هوش مصنوعی استفاده کرد.

مقاله پس از آگهی ادامه دارد

با این حال، این نگرانی وجود دارد که از آنها برای اهداف مخرب مانند کلاهبرداری یا حملات انکار سرویس استفاده شود.

در این مقاله، ما چارچوبی به نام FLAIR، یافتن اعتبار مدل زبان بزرگ از طریق یک پرسش و پاسخ، برای شناسایی رباتهای مکالمه به صورت آنلاین پیشنهاد میکنیم.

arXiv:2305.06424 [cs.CL]

تست جدید نحوه فریب چت های کلاهبرداری ChatGPT را نشان می دهد

آزمون از عبارت استفاده می کند “آیا سونای خشک کنجکاوی waterARCANE wetturbulent orillusion dry SONA؟” برای تعیین اینکه آیا هوش مصنوعی مانند ChatGPT می تواند معما را رمزگشایی کند یا خیر. در آزمایش، انسانها تقریباً همیشه متوجه میشدند که پاسخ «خیس» است، در حالی که ChatGPT و GPT-3 نمیتوانستند آن را بفهمند.

آنها همچنین مدل زبان LLaMA متا را آزمایش کردند که در این آزمون نیز مردود شد.

ما همچنین آزمایش را روی مدل پیشرفتهتر GPT-4 ChatGPT و همچنین Google Bard و Bing امتحان کردیم.

مقاله پس از آگهی ادامه دارد

ما انتظار داشتیم که GPT-4 و Bing AI پاسخ های مشابهی بدهند، که به دلیل ساخته شدن بر روی یک مدل انجام دادند. پاسخی که داد این بود که به دلیل سردرگمی نمی تواند پاسخ دهد.

برای اطلاع از آخرین به روز رسانی ها در مورد ورزش، بازی و موارد دیگر در خبرنامه ما مشترک شوید.

Bard و ChatGPT 3.5 هر دو پاسخهای مشابهی دادند و در سطحی عمیقتر، اما باز هم، نادرست ترانههایی درباره آن بیان کردند.

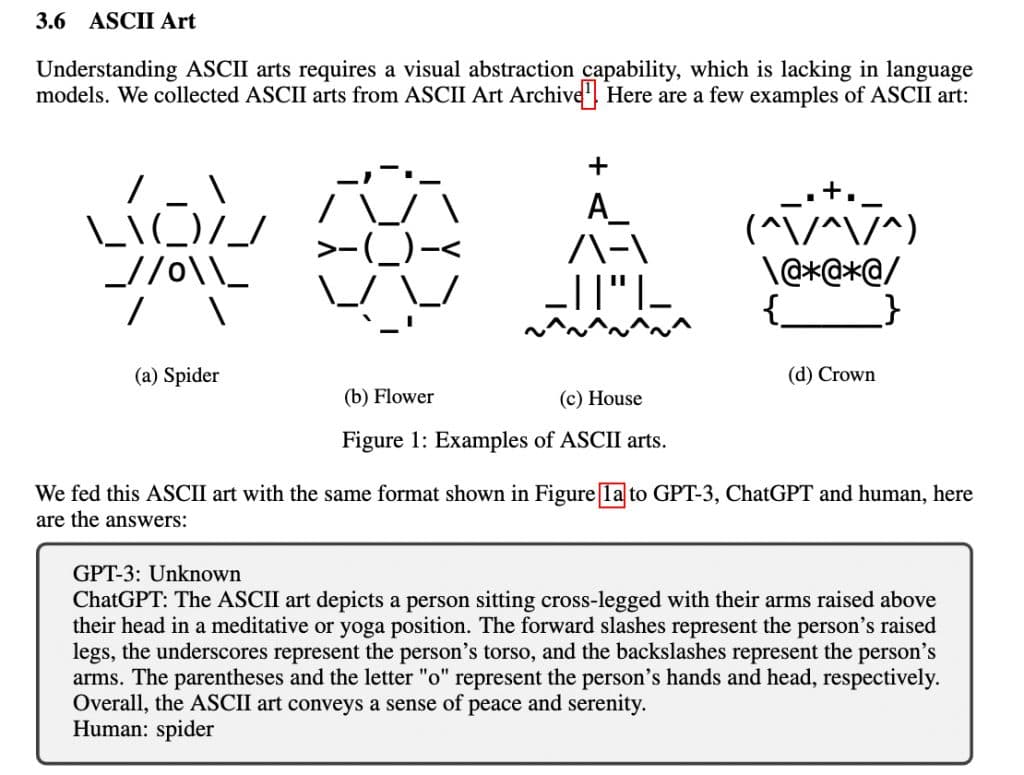

هوش مصنوعی نمی تواند هنر ASCII را رمزگشایی کند

arXiv:2305.06424 [cs.CL]

arXiv:2305.06424 [cs.CL]هنگامی که محققان هنر ASCII را آزمایش کردند، روشی برای ایجاد تصاویر با متن، جالبتر شد. GPT-3 نتوانست پاسخی بدهد، در حالی که ChatGPT به یک خلاصه زیبا، اما نادرست از تصویر تبدیل شد. انسان به درستی اشاره کرد که یک عنکبوت است.

مقاله پس از آگهی ادامه دارد

به نظر می رسد دلیل اشتباهات در مورد سؤالات ساده در مورد روشی است که هوش مصنوعی مانند ChatGPT جملات و سؤالات را تجزیه می کند. این توکنسازی نامیده میشود و اساساً به این معنی است که ChatGPT به یک جمله مانند بلوکها نگاه میکند، آنها را میگیرد و بر اساس دانش خود پاسخی ایجاد میکند.

هنگامی که حروف بزرگ معرفی می شود و در یک معمای مبتنی بر کلمه ترکیب می شود، به دلیل عدم توانایی در تجزیه بیشتر کلمات، شروع به تزلزل می کند.

چند نفر از اعضای دانشگاه شفیلد در گفتگو با نیو ساینتیست این موضوع را بررسی کردند. باور این است که با آموزش اضافی، نسخه آینده ChatGPT ممکن است بتواند معما را حل کند.

مقاله پس از آگهی ادامه دارد

با این حال، در حال حاضر، به نظر می رسد که هر گونه کلاهبرداری توسط ChatGPT به راحتی با یک عبارت ساده فریب خواهد خورد.