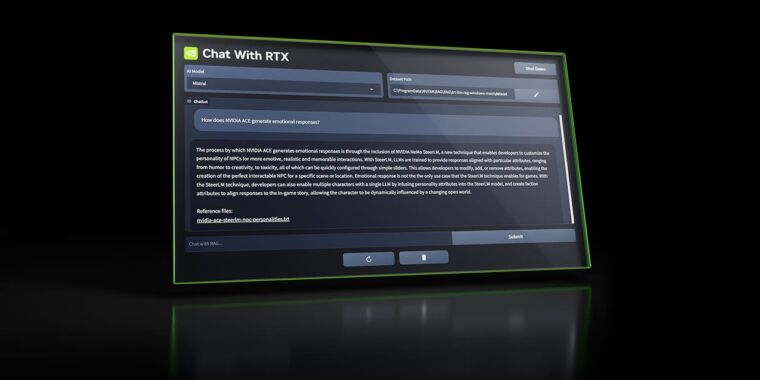

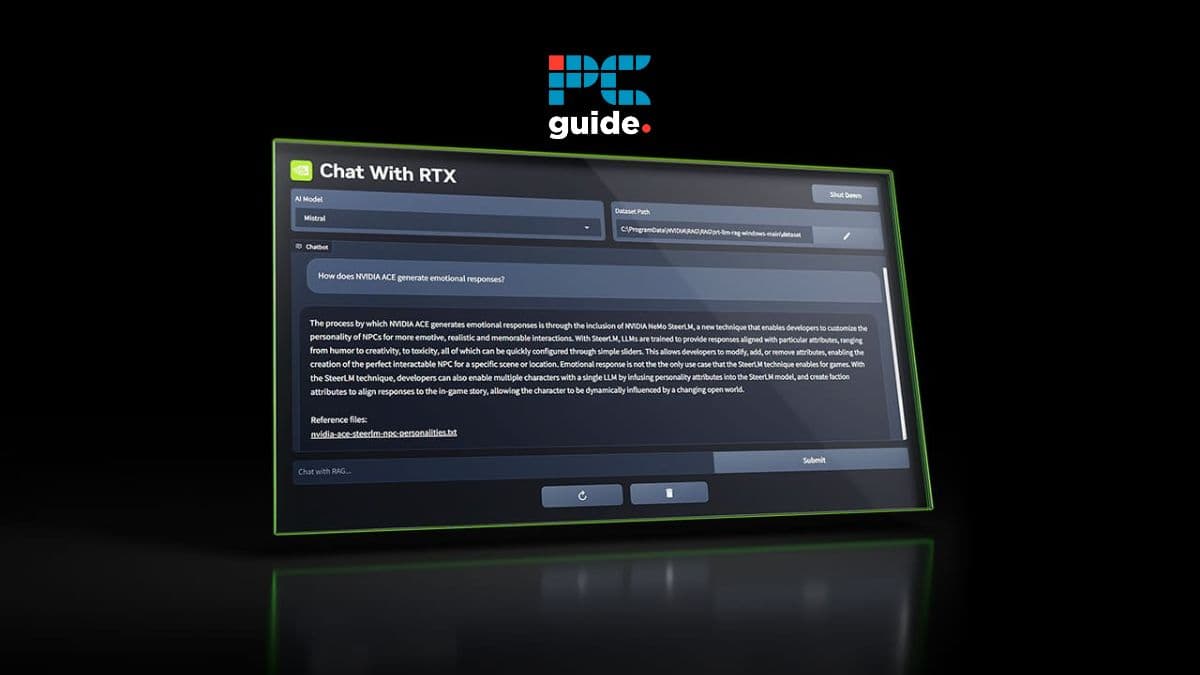

روز سهشنبه، انویدیا Chat With RTX را منتشر کرد، یک ربات چت مبتنی بر هوش مصنوعی شخصیسازیشده رایگان شبیه به ChatGPT که میتواند به صورت محلی روی رایانه شخصی با کارت گرافیک Nvidia RTX اجرا شود. از LLMهای با وزن باز Mistral یا Llama استفاده می کند و می تواند در فایل های محلی جستجو کرده و به سؤالات مربوط به آنها پاسخ دهد.

همچنین، این برنامه از انواع فرمت های فایل، از جمله TXT، .PDF، .DOCX و XML. پشتیبانی می کند. کاربران میتوانند این ابزار را برای مرور پوشههای خاص هدایت کنند، که Chat With RTX سپس آنها را اسکن میکند تا به سؤالات سریع پاسخ دهد. حتی امکان ترکیب اطلاعات از ویدیوها و لیستهای پخش YouTube را فراهم میکند و راهی برای گنجاندن محتوای خارجی در پایگاه داده دانش خود (به شکل جاسازیها) بدون نیاز به اتصال به اینترنت برای پردازش درخواستها ارائه میدهد.

اطراف لبه ها ناهموار

ما Chat With RTX را دانلود و اجرا کردیم تا آن را آزمایش کنیم. فایل دانلودی بسیار بزرگ است، در حدود 35 گیگابایت، به دلیل اینکه فایل های وزن Mistral و Llama LLM در توزیع گنجانده شده است. (“وزن” فایل های واقعی شبکه عصبی حاوی مقادیری هستند که نشان دهنده داده های آموخته شده در طول فرآیند آموزش هوش مصنوعی هستند.) هنگام نصب، Chat With RTX حتی فایل های بیشتری را دانلود می کند و در پنجره کنسول با استفاده از Python با رابطی که ظاهر می شود اجرا می شود. در یک پنجره مرورگر وب

چندین بار در طول آزمایش های ما روی RTX 3060 با 12 گیگابایت VRAM، Chat With RTX از کار افتاد. مانند رابطهای منبع باز LLM، Chat With RTX مجموعهای از وابستگیهای لایهای است که به Python، CUDA، TensorRT و دیگران متکی است. انویدیا کدی را برای شیک کردن و غیر شکننده کردن نصب آن شکسته است. این یک راه حل ناهموار در اطراف لبه ها است که نسبت به سایر رابط های محلی LLM (مانند GPT4ALL) بسیار شبیه پوسته Nvidia است. با این حال، قابل توجه است که این قابلیت به طور رسمی به طور مستقیم از Nvidia ارائه می شود.

در جنبه روشن (یک سمت روشن عظیم)، قابلیت پردازش محلی بر حریم خصوصی کاربر تأکید دارد، زیرا داده های حساس نیازی به انتقال به سرویس های مبتنی بر ابر (مانند ChatGPT) ندارند. استفاده از Mistral 7B همانند GPT-3 در اوایل سال 2022 به نظر می رسد، که هنوز برای یک LLM محلی که بر روی یک پردازنده گرافیکی مصرف کننده اجرا می شود قابل توجه است. این هنوز یک جایگزین واقعی ChatGPT نیست و نمی تواند بر GPT-4 Turbo یا Google Gemini Pro/Ultra در قابلیت پردازش پیشی بگیرد.

دارندگان GPU Nvidia می توانند Chat With RTX را به صورت رایگان در وب سایت Nvidia دانلود کنند.