مگر اینکه در چند ماه گذشته در مکانی دوردست و بدون دسترسی به اینترنت خلوت کرده باشید، به احتمال زیاد از میزان هیاهو و ترس در اطراف ChatGPT، چت ربات هوش مصنوعی (AI) توسعه یافته آگاه هستید. توسط OpenAI. شاید مقالاتی در مورد دانشگاهیان و معلمان دیده باشید که نگران این هستند که تقلب را آسان تر از همیشه کند. در طرف دیگر سکه، ممکن است مقالاتی را دیده باشید که همه برنامههای بالقوه ChatGPT را بشارت میدهند.

از طرف دیگر، ممکن است توسط برخی از نمونههای باطنیتر افرادی که از این ابزار استفاده میکنند، قلقلک داده باشید. به عنوان مثال، یکی از کاربران آن را به نوشتن یک راهنمای دستورالعمل برای حذف ساندویچ کره بادام زمینی از یک VCR در سبک کتاب مقدس پادشاه جیمز. دیگری از او خواست که آهنگی به سبک نیک کیو بنویسد. خواننده کمتر از نتایج مشتاق بود.

اما در میان آن همه هیاهو و بحث، به خطرات و مزایایی که ابزارهای هوش مصنوعی مانند ChatGPT در عرصه امنیت سایبری ارائه میکنند، توجه کافی صورت نگرفته است.

درک ChatGPT

برای اینکه تصور واضحتری از این خطرات و پاداشها داشته باشید، مهم است که درک بهتری از چیستی ChatGPT و تواناییهای آن داشته باشید.

ChatGPT (اکنون در آخرین نسخه خود، ChatGPT-4، منتشر شده در 14 مارس 2023) بخشی از یک خانواده بزرگ از ابزارهای هوش مصنوعی است که توسط شرکت آمریکایی OpenAI توسعه یافته است. در حالی که رسما ربات چت نامیده می شود، اما همه کاره بودن آن را کاملاً پوشش نمی دهد. با استفاده از تکنیک های یادگیری تحت نظارت و تقویتی آموزش دیده است، می تواند بسیار بیشتر از بسیاری از ربات های چت انجام دهد. به عنوان بخشی از پاسخ های خود، می تواند محتوا را بر اساس تمام اطلاعاتی که بر روی آن آموزش دیده است تولید کند. این اطلاعات شامل دانش عمومی و همچنین زبان های برنامه نویسی و کد است. در نتیجه، به عنوان مثال، می تواند کل اتاق گفتگو را شبیه سازی کند. بازی هایی مانند تیک تاک پا انجام دهید. و یک دستگاه خودپرداز را شبیه سازی کنید.

مهمتر از آن، برای کسبوکارها و سایر سازمانهای بزرگ، میتواند به بهبود خدمات مشتریان کسبوکار از طریق ارسال پیامهای شخصیتر و دقیقتر کمک کند. حتی می تواند برنامه های کامپیوتری را بنویسد و اشکال زدایی کند. برخی از این ویژگیها و سایر ویژگیها به این معنی است که هم میتواند یک متحد امنیت سایبری و هم یک تهدید باشد.

آموزش، فیلتر کردن، و تقویت دفاع

از جنبه مثبت، چیزهای زیادی برای گفتن ChatGPT وجود دارد. یکی از با ارزشترین نقشهایی که میتوانست ایفا کند، یکی از سادهترین نقشهاست: تشخیص فیشینگ. سازمانها میتوانند عادتی را در کارمندان خود ایجاد کنند که به موجب آن از ChatGPT برای تعیین اینکه آیا محتوایی که از آن مطمئن نیستند فیشینگ است یا با نیت مخرب تولید شده است، استفاده میکنند.

این مهم است زیرا، با وجود همه پیشرفتهای تکنولوژیکی در سالهای اخیر، حملات مهندسی اجتماعی مانند فیشینگ یکی از مؤثرترین اشکال جرایم سایبری باقی مانده است. در واقع، تحقیقات نشان می دهد که از حملات سایبری که در سال 2022 با موفقیت در بریتانیا شناسایی شد، 83 درصد شامل نوعی فیشینگ بود.

البته، راههای متعدد دیگری وجود دارد که از ChatGPT میتوان برای تقویت تلاشهای امنیت سایبری استفاده کرد. برای مثال، میتواند درجهای از کمک به کارکنان امنیتی جوانتر ارائه کند، خواه در برقراری ارتباط با مسائلی باشد که ممکن است داشته باشند یا به آنها کمک کند تا زمینه کاری را که قرار است در هر نقطه خاص روی آن کار کنند، درک کنند. همچنین میتواند به تیمهای فاقد منابع کمک کند تا آخرین تهدیدات و آسیبپذیریهای داخلی را شناسایی کنند.

افراد بد نیز از آن استفاده می کنند

اما حتی در حالی که متخصصان امنیت سایبری راههای استفاده از ChatGPT را به نفع خود بررسی میکنند، مجرمان سایبری نیز چنین هستند. برای مثال، آنها ممکن است از توانایی آن برای تولید کدهای مخرب استفاده کنند. از طرف دیگر، آنها ممکن است از آن برای تولید محتوایی استفاده کنند که به نظر می رسد توسط انسان تولید شده است، که به طور بالقوه برای فریب کاربران برای کلیک کردن بر روی پیوندهای مخرب استفاده می شود، که ناآگاهانه منجر به عواقب خطرناکی می شود.

برخی حتی از ChatGPT برای تقلید متقاعدکنندهای از دستیاران هوش مصنوعی قانونی در وبسایتهای شرکتی استفاده میکنند و راه جدیدی را در جبهه نبرد مهندسی اجتماعی باز میکنند. به یاد داشته باشید، موفقیت مجرمان سایبری تا حد زیادی به این بستگی دارد که بتوانند هر چه بیشتر آسیب پذیری های ممکن را، در مکرر و سریع ترین زمان ممکن هدف قرار دهند. ابزارهای هوش مصنوعی مانند ChatGPT به آنها این امکان را می دهد که اساساً به عنوان یک دستیار فوق شارژ عمل کنند که می تواند به ایجاد تمام دارایی های مورد نیاز برای کمپین های مخرب کمک کند.

از ابزارهای موجود استفاده کنید

پس باید واضح باشد که اگر مجرمان سایبری از ChatGPT و سایر ابزارهای هوش مصنوعی برای تقویت حملات خود استفاده می کنند، تیم امنیتی شما نیز باید از آنها برای تقویت تلاش های امنیت سایبری شما استفاده کند. خوشبختانه لازم نیست به تنهایی این کار را انجام دهید.

ارائهدهنده امنیت مناسب فقط درگیر تحقیقات مداوم در مورد اینکه چگونه مجرمان سایبری از جدیدترین فناوریها برای تقویت حملات خود استفاده میکنند، نمیپردازد، بلکه چگونه میتوان از آن فناوریها برای بهبود تشخیص، پیشگیری و دفاع از تهدید استفاده کرد. و با آسیبهایی که یک حمله امنیت سایبری میتواند به زیرساختهای حیاتی شما وارد کند، این چیزی است که آنها باید فعالانه درباره آن به شما هم بگویند.

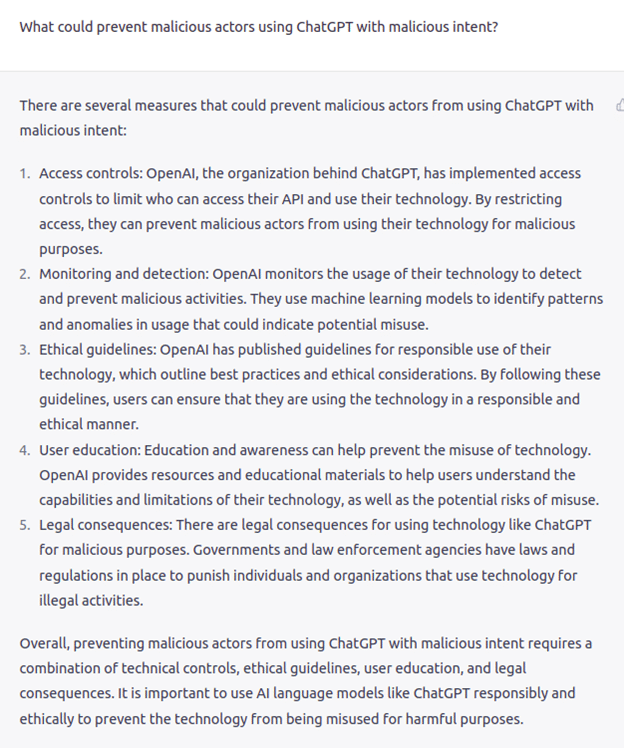

ChatGPT-4

با جدیدترین نسخه ChatGPT (ChatGPT-4)، OpenAI جدیدترین و قدرتمندترین مدل مکالمه را در دسترس قرار داده است و همچنین کنترل های بیشتری را برای جلوگیری از سوء استفاده از آن معرفی کرده است. ما از ChatGPT پرسیدیم “چه چیزی می تواند مانع از استفاده بازیگران مخرب از ChatGPT با نیت مخرب شود” و این جواب بود:

بنابراین ChatGPT پیش رفت و تمام اقداماتی را که OpenAI برای جلوگیری از سوء استفاده از آن انجام داده است، برشمرد. OpenAI در وبلاگ انتشار ChatGPT-4 توضیح داد که چگونه این مدل ظاهراً ایمن تر از مدل های قبلی خود است:ما 6 ماه را صرف ساختن GPT-4 ایمن تر و هماهنگ تر کردیم. GPT-4 نسبت به GPT-3.5 در ارزیابیهای داخلی ما، 82 درصد کمتر به درخواستهای محتوای غیرمجاز پاسخ میدهد و 40 درصد بیشتر احتمال دارد که پاسخهای واقعی بدهد.“.

بنابراین همه نشان می دهد که اقدامات صحیح برای جلوگیری از سوء استفاده از آن همچنان بهبود می یابد، اما همانطور که همه ما می دانیم افراد بد به یافتن راه هایی برای غلبه بر این محدودیت ها ادامه می دهند زیرا این مدل به طور گسترده ای مورد استفاده و درک قرار می گیرد.

اعتبار تصویر: [email protected]/depositphotos.com

JP Perez-Etchegoyen مدیر ارشد فناوری Onapsis است.