انویدیا اولین پردازنده گرافیکی دوگانه PCIe خود را در سالهای اخیر راهاندازی میکند، نه برای گیمرها

NVIDIA یک نوع جدید از Hopper GPU دارد که منحصراً برای مدلهای زبان بزرگ (LLM) مانند Chat-GPT طراحی شده است.

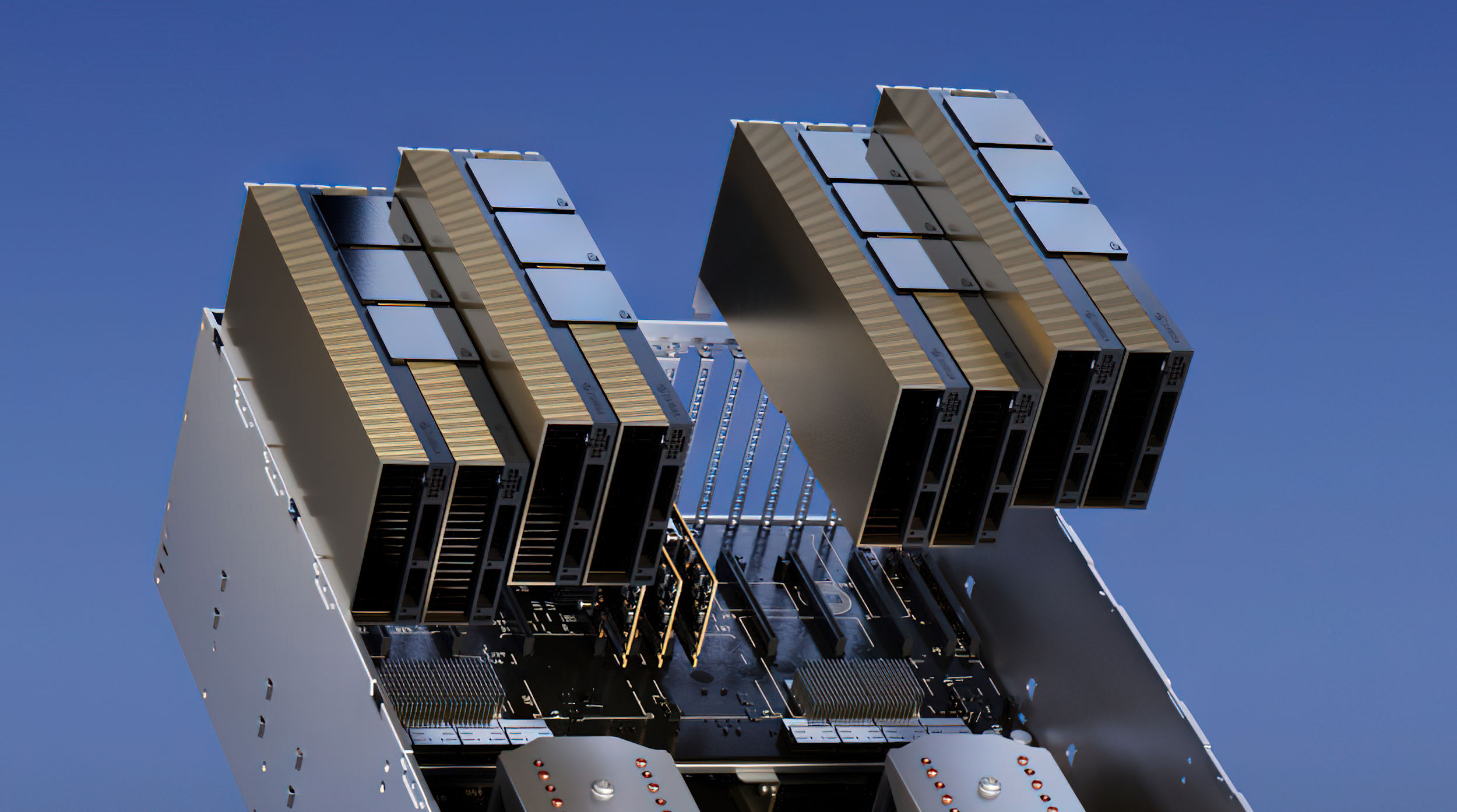

H100 NVL dual-GPU، منبع: NVIDIA

H100 NVL نشان دهنده بهترین سطل در مجموعه NVIDIA Hopper است. این یک نوع فنی از شتاب دهنده مرکز داده H100 است که به طور خاص برای یک هدف طراحی شده است، تا مدل های زبان هوش مصنوعی مانند Chat-GPT را تقویت کند.

به طور خلاصه، NVL مخفف NVLink است که توسط این پیکربندی در GPU H100 استفاده می شود. H100 NVL یک GPU نیست، بلکه یک گزینه GPU دوگانه از دو کارت PCIe است که از طریق سه پل NVLink Gen4 به یکدیگر متصل شده اند.

اما نوع NVL مزیت دیگری نسبت به پردازندههای گرافیکی H100 دارد: ظرفیت حافظه. این GPU از هر شش پشته حافظه HBM3 استفاده می کند که در مجموع 188 گیگابایت بافر پرسرعت ارائه می کند. این یک ظرفیت غیرعادی است که نشان می دهد تنها 94 گیگابایت در هر پردازنده گرافیکی موجود است، نه 96 گیگابایت.

NVIDIA H100 Hopper سری GPU، منبع: NVIDIA

H100 NVL دارای یک رابط حافظه کامل 6144 بیتی (1024 بیت برای هر پشته HBM3) و سرعت حافظه تا 5.1 گیگابیت بر ثانیه است. این بدان معناست که حداکثر توان خروجی 7.8 گیگابایت بر ثانیه است که بیش از دو برابر H100 SXM است. مدلهای زبان بزرگ به بافرهای بزرگ نیاز دارند و پهنای باند بالاتر نیز مطمئناً تأثیر خواهد داشت.

NVIDIA H100 NVL برای استقرار مدل زبان بزرگ برای استقرار LLM های عظیم مانند ChatGPT در مقیاس ایده آل است. H100 NVL جدید با 94 گیگابایت حافظه با شتاب موتور ترانسفورماتور تا 12 برابر عملکرد استنتاج سریعتری را در GPT-3 در مقایسه با نسل قبلی A100 در مقیاس مرکز داده ارائه میکند.

انویدیا انتظار دارد پردازنده گرافیکی H100 NVL در نیمه دوم سال جاری بدون ارائه جزئیات بیشتر عرضه شود.

منبع: NVIDIA از طریق AnandTech